Les assistants IA deviennent rapidement essentiels à la manière dont les entreprises gèrent la communication, en particulier dans les domaines du support et des opérations. Qu'il s'agisse de suggérer des réponses par e-mail ou de gérer des conversations entières, ils permettent aux équipes d'évoluer sans augmenter la charge de travail, et les clients bénéficient en retour d'un service plus rapide et plus précis.

Mais comment les assistants IA travaillent-ils exactement dans les coulisses ? Qu'est-ce qui renforce leur capacité à comprendre, à réagir et à s'améliorer au fil du temps ?

Décomposons-le.

Que sont les assistants IA ?

Les assistants d'IA sont des systèmes logiciels qui traitent le langage naturel, récupèrent des informations pertinentes et prennent des actions, soit en générant du contenu, soit en automatisant des tâches, soit en répondant directement aux utilisateurs.

Contrairement aux chatbots qui suivent des règles strictes, les assistants IA modernes sont alimentés par des modèles linguistiques, l'apprentissage automatique et des systèmes de récupération. Ils ne se contentent pas de faire correspondre les mots clés ; ils interprètent le contexte, hiérarchisent les urgences et s'améliorent en fonction de l'utilisation.

📊 Selon une étude menée par Servion Global Solutions, 95 % des interactions avec les clients seront alimentées par l'IA d'ici 2025, un signe clair que les assistants d'IA ne sont pas un luxe, mais une couche essentielle de l'infrastructure de support.

👉 Vous pouvez explorer une ventilation complète des qu'est-ce qu'un assistant IA, et en quoi il diffère des chatbots de base sur ce blog Gmelius.

Technologies clés qui alimentent les assistants d'IA

La création d'un assistant d'IA nécessite plus qu'un simple LLM (Large Language Model). Voici les composants essentiels qui rendent les assistants modernes intelligents, rapides et fiables :

- Traitement du langage naturel (NLP) :

Décompose les phrases en leurs composants (jetons, parties du discours) pour comprendre ce que l'utilisateur veut dire, et pas seulement ce qu'il dit. - Modèles linguistiques étendus (LLM) :

Ce sont les moteurs principaux (comme le GPT-4 ou Claude d'OpenAI) qui génèrent des réponses. Ils ont été formés à partir de milliards d'exemples pour comprendre la grammaire, l'intention et le style. - Génération augmentée par récupération (RAG) :

Plutôt que de se fier uniquement aux données de formation, RAG extrait les informations pertinentes à partir d'une source connectée (vos documents d'aide, par exemple) et les transmet au LLM. Les réponses sont ainsi plus précises et plus sensibles au contexte. - Classification des intentions et extraction des entités :

Détermine ce que l'utilisateur souhaite faire (par exemple, « annuler l'abonnement ») et extrait toutes les informations clés (par exemple, l'identifiant du compte) pour effectuer la tâche. - Graphiques de connaissances :

Des bases de données structurées qui cartographient les relations entre les éléments, par exemple quels clients peuvent prétendre à quel niveau ou quelles politiques s'appliquent à quelles régions. Ils aident les assistants à raisonner dans des scénarios plus complexes. - Analyse des sentiments et des émotions :

Permet de déterminer si l'utilisateur est frustré, confus ou content, ce qui est essentiel pour établir des priorités ou adapter le ton. - Apprentissage par renforcement à partir de la rétroaction humaine (RLHF) :

L'IA découvre quelles réponses sont utiles en fonction des votes positifs, négatifs ou des corrections de suivi. Cela permet de boucler la boucle et d'améliorer continuellement l'assistant. - Synthèse vocale et synthèse vocale :

Permet les interactions vocales dans les applications, l'assistance téléphonique ou les appareils intelligents. - Boutiques d'intégration vectorielle sécurisées :

Stockez le contenu de la base de connaissances sous forme de vecteurs (sens sémantique, pas seulement des mots), ce qui permet une recherche sémantique rapide et privée dans votre propre environnement cloud. - Orchestration des outils et des API :

L'assistant peut avoir besoin d'appeler des API, de déclencher des flux de travail ou d'extraire des données à partir d'outils tiers. Les frameworks d'orchestration gèrent cette interaction en toute sécurité.

Étape par étape : comment un assistant IA répond à une requête

Les assistants IA peuvent sembler magiques, mais sous le capot, ils suivent un pipeline technique clair. Voici comment fonctionne généralement le processus :

1. Collecte d'entrées

L'assistant commence par une saisie utilisateur, qui peut provenir de différents canaux : un e-mail saisi, un message de chat en direct, un formulaire de contact ou une voix via une interface de centre d'appels. Chacune de ces entrées est capturée via des API ou des widgets intégrés et acheminée vers le pipeline de traitement de l'assistant. Les formats d'entrée sont normalisés dans une demande structurée pour les tâches en aval, comprenant souvent des métadonnées de session (horodatage, canal, ID utilisateur) pour une prise en compte du contexte.

2. Reconnaissance vocale (si la saisie inclut la voix)

Lorsque l'utilisateur parle au lieu de taper, le système déclenche un Reconnaissance vocale automatique (ASR) moteur pour convertir les signaux audio en texte. Ce processus implique l'analyse de la forme d'onde, la détection de phonèmes et la modélisation du langage. Les systèmes ASR modernes utilisent souvent des modèles d'apprentissage profond (tels que Wav2Vec 2.0 ou Whisper) entraînés sur des ensembles de données multilingues et spécifiques à un domaine afin d'améliorer la précision de la transcription dans des environnements bruyants ou avec des accents non natifs.

3. Prétraitement

Le texte brut est normalisé pour gérer les variations d'orthographe, de temps et de mise en forme. Cela inclut la tokenisation, la lemmatisation (réduire « courir » à « courir ») et le développement des abréviations ou de l'argot (« tmrw » → « demain »). Informations personnelles identifiables (PII) tels que les adresses e-mail ou les numéros de compte, sont expurgés ou masqués, à la fois pour des raisons de confidentialité et pour éviter de fausser les prévisions des modèles en aval. Le résultat est une entrée propre et sémantiquement riche, prête à être analysée intentionnellement.

4. Détection des intentions

Un classificateur d'intention entraîné (généralement basé sur des modèles de transformateurs tels que BERT ou RoberTA) associe les entrées de l'utilisateur à une classe d'intention prédéfinie. Par exemple, « Puis-je consulter ma facture du mois dernier ? » peut être étiqueté avec l'intention billing_view_invoice. Des seuils de confiance sont appliqués pour réduire l'ambiguïté et des réponses de repli (par exemple, « Pouvez-vous clarifier votre demande ? ») sont déclenchés lorsque l'incertitude dépasse une limite définie. Les fonctionnalités multilingues et multi-objectifs peuvent également être prises en charge en fonction de la portée de l'assistant.

5. Extraction d'entités

En utilisant Reconnaissance d'entités nommées (NER), l'assistant identifie des points de données structurés, tels que les numéros de commande, les SKU des produits, les plages de dates ou les emplacements. Ces entités sont annotées et stockées dans un objet de contexte qui persiste tout au long de la conversation. Les modèles d'extraction peuvent être basés sur des règles (regex) ou basés sur le ML, en fonction de la complexité des types d'entités et de la spécificité du domaine. Ces valeurs sont essentielles pour les appels d'API, le remplissage automatique des formulaires ou la recherche contextuelle.

6. Extraction du contexte

Avec l'intention et les entités en main, l'assistant interroge des sources de données pertinentes, telles qu'une base de données vectorielle d'articles de la base de connaissances (à l'aide d'intégrations via OpenAI ou Cohere), des enregistrements de gestion de la relation client (CRM) ou des transcriptions de conversations passées. La recherche de similarité sémantique garantit que non seulement les correspondances de mots clés, mais aussi les entrées conceptuellement liées sont récupérées. L'assistant crée une pile contextuelle à référencer lors de la prise de décision et de la génération de réponses.

7. Prise de décisions

En fonction de l'intention, des entités et du contexte récupéré, l'assistant choisit l'action suivante. Il peut s'agir d'une règle codée en dur (par exemple, « if intent = reset_password → trigger workflow ») ou d'un moteur de politique dynamique piloté par l'apprentissage par renforcement ou des arbres de décision. Les systèmes avancés peuvent intégrer des algorithmes de planification basés sur l'IA pour séquencer plusieurs actions. Si une escalade est requise (par exemple, si l'intention est sensible ou complexe), l'assistant achemine la requête vers un humain avec un contexte prérempli.

8. Génération de réponses

L'assistant élabore désormais une réponse à l'aide de Génération augmentée par récupération (RAG). Cela combine les données récupérées (par exemple, un article d'aide ou un profil utilisateur) avec un modèle linguistique tel que GPT pour générer des réponses personnalisées en langage naturel. À des fins transactionnelles, il peut appeler des API pour récupérer des données en temps réel (par exemple, l'état des commandes) ou lancer des processus backend. Les réponses sont formatées pour des raisons de ton, de longueur et de clarté, en utilisant souvent des instructions en quelques coups pour rester en phase avec la voix de l'entreprise.

9. Rambardes

Avant l'envoi, le système effectue plusieurs contrôles de sécurité. Il s'agit notamment des filtres de politique (par exemple, empêcher l'envoi d'informations d'identification), de l'analyse du ton (assurez-vous que l'assistant ne semble pas grossier ou méprisant) et des points de contrôle intégrés pour les catégories signalées (par exemple, clients juridiques, de conformité, clients VIP). Les classificateurs de toxicité, les détecteurs PII et les limiteurs de débit contribuent à garantir un comportement responsable de l'IA. La journalisation est effectuée en parallèle à des fins de conformité et d'audit.

10. Livraison + journalisation

Une fois approuvée, l'assistant transmet la réponse via le même canal d'origine : e-mail, chat ou voix. Simultanément, il enregistre les métadonnées de la session, les scores de satisfaction des utilisateurs (via des invites de pouce levé ou CSAT) et des indicateurs clés tels que délai jusqu'à la première réponse (TTFR) ou délai de résolution. Ces données sont intégrées au pipeline d'entraînement, où le réglage supervisé ou RLHF (Reinforcement Learning from Human Feedback) améliore les performances futures.

Au fil du temps, cette boucle s'améliore. Les nouveaux articles sont indexés, de nouveaux modèles sont appris et les commentaires mettent à jour le modèle. Le résultat ? Un assistant plus intelligent qui suit le rythme de vos produits, de vos clients et de vos flux de travail.

Vous êtes curieux de connaître l'impact global ? En savoir plus sur comment les assistants d'IA aident les entreprises améliorez l'efficacité, réduisez les coûts et évoluez plus intelligemment.

Exemples concrets : assistants IA dans Gmail

Avec des plateformes comme Gmelius, les assistants IA sont intégrés directement dans Gmail. Vous n'avez pas besoin d'une nouvelle application, mais simplement d'une messagerie plus intelligente.

Les assistants Gmelius AI vont au-delà de l'automatisation au niveau de la surface. Ils peuvent se connecter en toute sécurité à votre documentation interne, à votre centre d'aide ou à votre base de connaissances pour fournir des réponses basées sur les flux de travail et la langue réels de votre entreprise.

Une fois connecté, l'assistant crée un index vectoriel privé et sécurisé de votre contenu, entièrement chiffré et jamais partagé ni utilisé pour entraîner des modèles externes. Propulsé par l'IA Gemini de Google et profondément intégré à Gmail, l'assistant met à jour ses connaissances en permanence chaque semaine, afin de refléter vos derniers processus, politiques et connaissances de votre équipe avec précision et confidentialité.

Voici deux exemples pratiques :

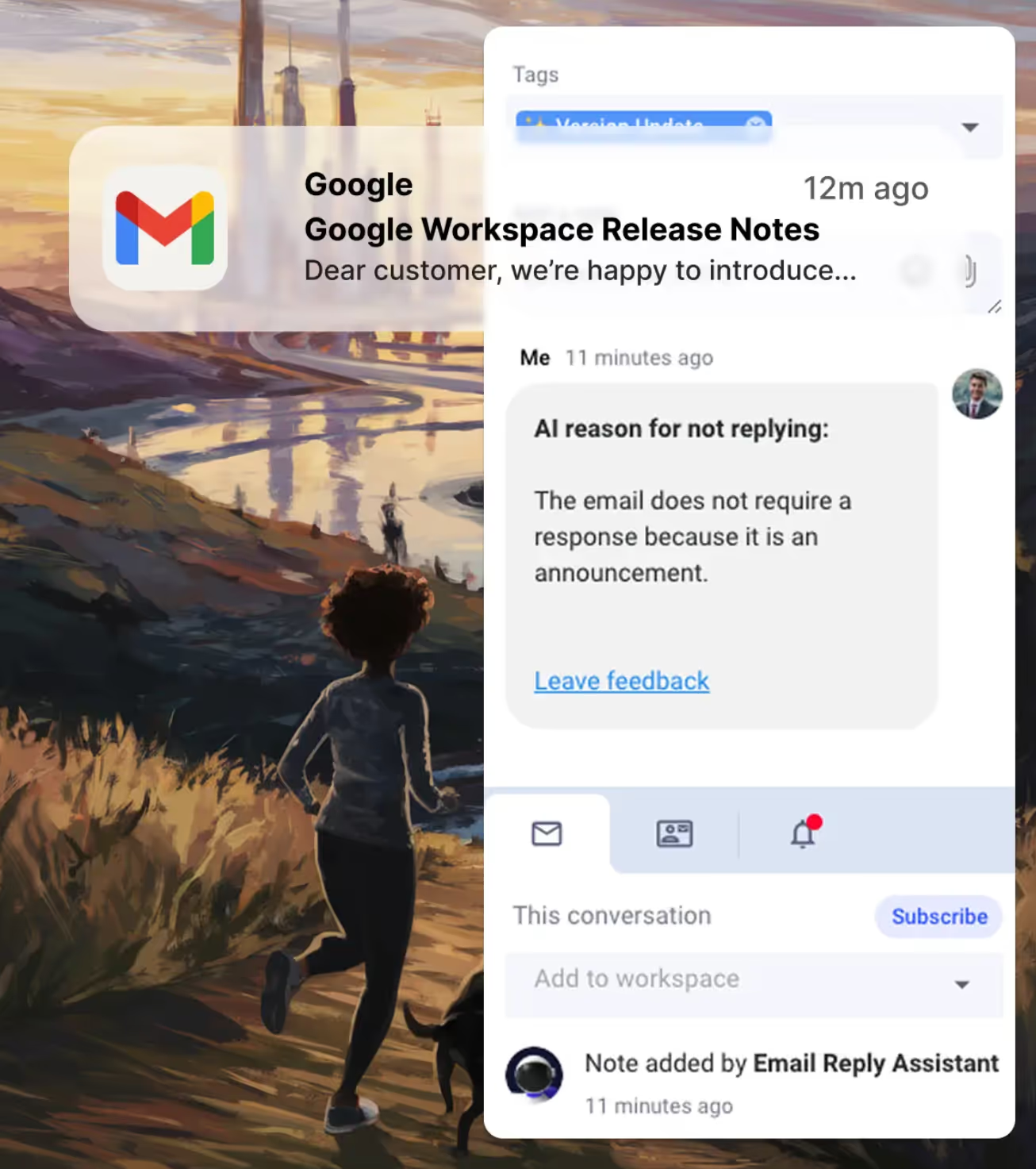

Assistant de réponse aux e-mails Gmelius

Cet assistant rédige des réponses intelligentes aux e-mails entrants en fonction du fil de conversation, des modèles enregistrés et de la base de connaissances de l'entreprise. Il comprend le ton, l'intention et l'urgence. Par conséquent, les agents humains peuvent simplement les examiner et les envoyer.

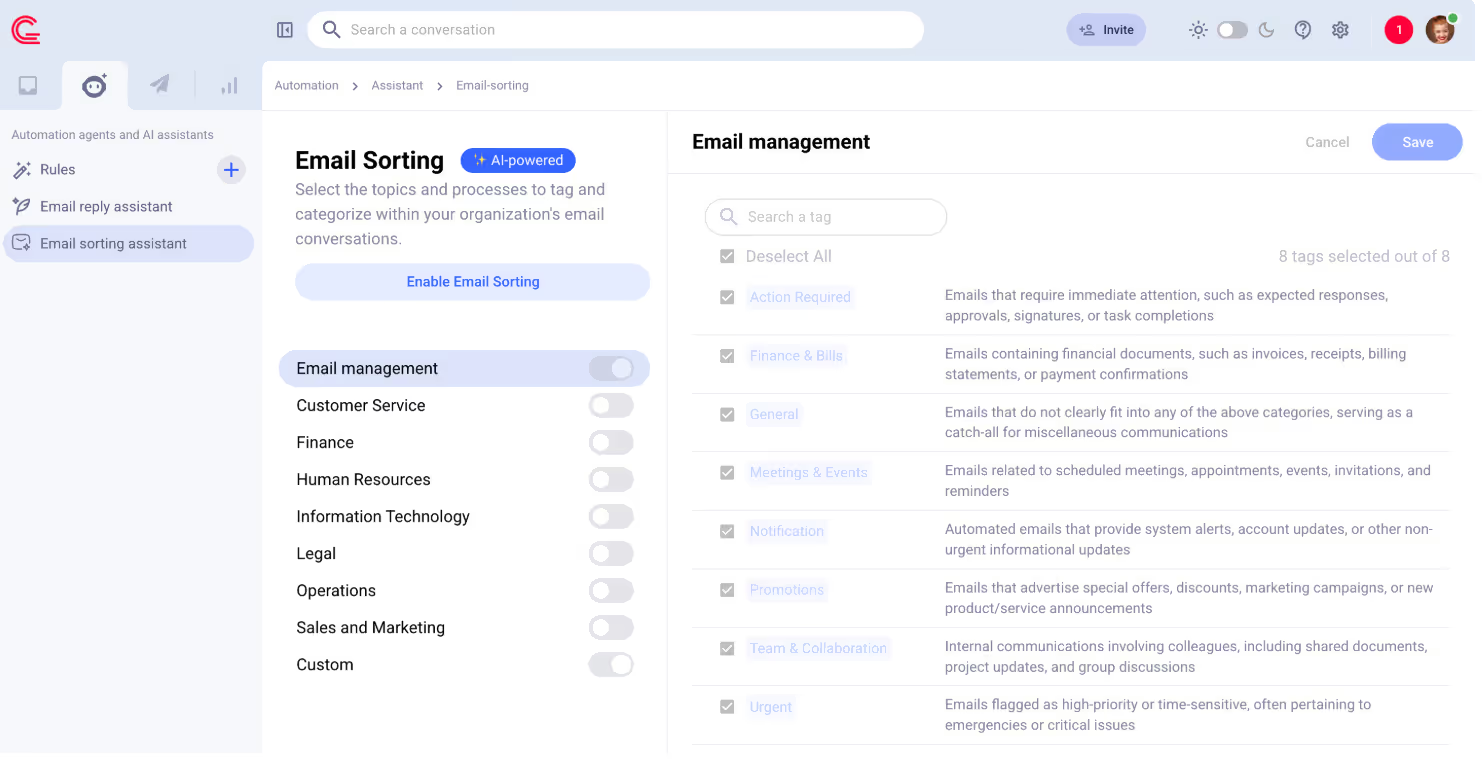

Assistant de tri des e-mails Gmelius

Classifie automatiquement les e-mails (facturation, assistance, commentaires, etc.) et les achemine vers la bonne personne ou le bon tag. Les équipes éliminent le triage manuel et réduisent le temps de réponse à tous les niveaux.

Comment faire en sorte que les assistants IA travaillent pour vous

Si vous envisagez d'ajouter un assistant IA à votre flux de travail d'assistance ou d'exploitation, gardez ces bonnes pratiques à l'esprit :

1. Commencez par la répétition

Identifiez les 3 à 5 tâches que vous répétez le plus : « Où est ma commande ? » , « Comment puis-je réinitialiser mon mot de passe ? » , « Puis-je obtenir une copie de ma facture ? » Ce sont là des avantages faciles pour l'automatisation.

2. Utilisez vos propres connaissances

Téléchargez des documents internes, des manuels de produits et du contenu des FAQ. Cela garantit que votre assistant donne des réponses dans votre langue, en utilisant des informations précises.

3. Tenez les humains au courant

Autorisez toujours l'approbation de l'agent pour les réponses complexes ou sensibles, en particulier pendant la première phase. L'IA doit aider, et non remplacer, votre équipe.

4. Suivez les performances

Examinez des indicateurs tels que :

- Temps de première réponse (FRT)

- Délai de résolution (TTR)

- Taux de renvoi (nombre de requêtes traitées sans intervention de l'agent)

5. Actualisez souvent

Définissez un calendrier de mise à jour récurrent afin que votre assistant puisse accéder au nouveau contenu du centre d'aide, aux modifications apportées aux produits ou aux changements de politique.

6. Améliorez les incitations au fil du temps

Au fur et à mesure que l'assistant gère de plus en plus de requêtes, regardez celles auxquelles il ne répond pas bien. Améliorez vos supports de formation et vos instructions pour combler ces lacunes.

Conclusion

Les assistants IA font déjà partie du flux de travail quotidien de milliers d'équipes d'assistance, d'entreprises SaaS et d'opérations de commerce électronique. Lorsqu'ils sont connectés à votre base de connaissances actuelle et gérés avec les bonnes garanties, ils réduisent la charge de travail, améliorent l'expérience client et aident les équipes à se développer plus intelligemment.

Ce qui exigeait auparavant des heures d'efforts humains (acheminer des messages, extraire des données, répondre de manière cohérente) est désormais géré en quelques secondes par des assistants intelligents qui apprennent, s'adaptent et évoluent en fonction de votre entreprise.

Que vous soyez une start-up en pleine croissance ou une équipe bien établie enterrée sous les e-mails, le message est clair : si vous continuez à tout faire manuellement, vous êtes déjà en retard.

Avec des outils tels que Assistants Gmelius AI, vous n'avez pas besoin de remanier votre stack ou de créer votre propre solution. Il vous suffit de le connecter à Gmail et de le laisser fonctionner.

👉 Essayez Gmelius gratuitement

.avif)

.png)

.avif)

.avif)