Os assistentes de IA estão rapidamente se tornando essenciais para a forma como as empresas gerenciam a comunicação, especialmente em suporte e operações. Desde sugerir respostas por e-mail até lidar com conversas inteiras, elas permitem que as equipes cresçam sem aumentar a carga de trabalho, e os clientes recebem um serviço mais rápido e preciso em troca.

Mas como exatamente os assistentes de IA trabalham nos bastidores? O que fortalece sua capacidade de entender, responder e melhorar com o tempo?

Vamos detalhar isso.

O que são assistentes de IA?

Os assistentes de IA são sistemas de software que processam a linguagem natural, recuperam informações relevantes e agem, seja gerando conteúdo, automatizando tarefas ou respondendo diretamente aos usuários.

Ao contrário dos chatbots que seguem regras rígidas do tipo “se-is-ente-aquilo”, os assistentes de IA modernos são alimentados por modelos de linguagem, aprendizado de máquina e sistemas de recuperação. Eles não apenas combinam palavras-chave; eles interpretam o contexto, priorizam a urgência e melhoram com o uso.

📊 De acordo com uma pesquisa conduzida pela Servion Global Solutions, 95% das interações com os clientes serão impulsionadas pela IA até 2025, um sinal claro de que os assistentes de IA não são um luxo, mas uma camada central na infraestrutura de suporte.

👉 Você pode explorar uma análise completa de o que é um assistente de IAe como eles diferem dos chatbots básicos neste blog do Gmelius.

Principais tecnologias que potencializam os assistentes de IA

Construir um assistente de IA requer mais do que apenas um LLM (Large Language Model). Aqui estão os componentes essenciais que tornam os assistentes modernos inteligentes, rápidos e confiáveis:

- Processamento de linguagem natural (PNL):

Divide as frases em seus componentes (símbolos, partes do discurso) para entender o que o usuário quer dizer, não apenas o que ele diz. - Modelos de linguagem grande (LLMs):

Esses são os principais mecanismos (como o GPT-4 ou Claude da OpenAI) que geram respostas. Eles foram treinados em bilhões de exemplos para entender gramática, intenção e estilo. - Geração aumentada por recuperação (RAG):

Em vez de confiar apenas nos dados de treinamento, o RAG busca informações relevantes de uma fonte conectada (seus documentos de ajuda, por exemplo) e as envia para o LLM. Isso torna as respostas mais precisas e sensíveis ao contexto. - Classificação de intenções e extração de entidades:

Determina o que o usuário quer fazer (por exemplo, “cancelar assinatura”) e extrai qualquer informação importante (por exemplo, ID da conta) para realizar a tarefa. - Gráficos de conhecimento:

Bancos de dados estruturados que mapeiam relacionamentos entre coisas, como quais clientes se qualificam para qual nível ou quais políticas se aplicam a quais regiões. Isso ajuda os assistentes a raciocinar em cenários mais complexos. - Análise de sentimentos e emoções:

Avalia se o usuário está frustrado, confuso ou feliz, o que é essencial para priorizar ou adaptar o tom. - Aprendizagem por reforço a partir do feedback humano (RLHF):

A IA aprende quais respostas são úteis com base em votos positivos, negativos ou correções de acompanhamento. Isso fecha o circuito e melhora continuamente o assistente. - Conversão de texto em fala e fala em texto:

Permite interações de voz em aplicativos, suporte por telefone ou dispositivos inteligentes. - Armazenamentos seguros de incorporação de vetores:

Armazene o conteúdo da base de conhecimento como vetores (significado semântico, não apenas palavras), permitindo uma busca semântica rápida e privada em seu próprio ambiente de nuvem. - Orquestração de ferramentas e APIs:

Talvez o assistente precise chamar APIs, acionar fluxos de trabalho ou extrair dados de ferramentas de terceiros. As estruturas de orquestração gerenciam essa interação com segurança.

Passo a passo: como um assistente de IA responde a uma consulta

Os assistentes de IA podem parecer mágicos, mas, nos bastidores, eles seguem uma linha técnica clara. Veja como o processo normalmente funciona:

1. Coleta de entradas

O assistente começa com a entrada do usuário, que pode vir de vários canais: um e-mail digitado, uma mensagem de bate-papo ao vivo, um formulário de contato ou voz por meio de uma interface de call center. Cada uma dessas entradas é capturada por meio de APIs ou widgets integrados e roteada para o pipeline de processamento do assistente. Os formatos de entrada são padronizados em uma solicitação estruturada para tarefas posteriores, geralmente incluindo metadados da sessão (data e hora, canal, ID do usuário) para reconhecimento contextual.

2. Reconhecimento de fala (se a entrada incluir voz)

Quando o usuário fala em vez de digitar, o sistema aciona um Reconhecimento Automático de Fala (ASR) mecanismo para converter sinais de áudio em texto. Esse processo envolve análise de formas de onda, detecção de fonemas e modelagem de linguagem. Os sistemas ASR modernos geralmente usam modelos de aprendizado profundo (como Wav2Vec 2.0 ou Whisper) treinados em conjuntos de dados multilíngues e específicos de domínios para melhorar a precisão da transcrição em ambientes ruidosos ou com sotaques não nativos.

3. Pré-processamento

O texto bruto é normalizado para lidar com variações na ortografia, no tempo e na formatação. Isso inclui tokenização, lematização (redução de “correr” para “correr”) e expansão de abreviações ou gírias (“tmrw” → “amanhã”). Informações de identificação pessoal (PII) por exemplo, endereços de e-mail ou números de contas são editados ou mascarados, tanto para privacidade quanto para evitar distorções nas previsões do modelo posterior. O resultado é uma entrada limpa e semanticamente rica, pronta para análise de intenções.

4. Detecção de intenção

Um classificador de intenção treinado (normalmente baseado em modelos de transformadores como BERT ou RobertA) mapeia a entrada do usuário para uma classe de intenção predefinida. Por exemplo, “Posso verificar minha fatura do mês passado?” pode ser marcado com a intenção billing_view_invoice. Limites de confiança são impostos para reduzir a ambigüidade e as respostas alternativas (por exemplo, “Você pode esclarecer sua solicitação?”) são acionados quando a incerteza excede um limite definido. Recursos multilíngues e multiintencionais também podem ser suportados, dependendo do escopo do assistente.

5. Extração de entidades

Usando Reconhecimento de entidade nomeada (NER), o assistente identifica pontos de dados estruturados, como números de pedidos, SKUs de produtos, intervalos de datas ou locais. Essas entidades são anotadas e armazenadas em um objeto de contexto que persiste durante a conversa. Os modelos de extração podem ser baseados em regras (regex) ou baseados em ML, dependendo da complexidade dos tipos de entidade e da especificidade do domínio. Esses valores são essenciais para chamadas de API, preenchimento automático de formulários ou pesquisa contextual.

6. Recuperação de contexto

Com a intenção e as entidades em mãos, o assistente consulta fontes de dados relevantes, como um banco de dados vetorial de artigos da base de conhecimento (usando incorporações via OpenAI ou Cohere), registros de gerenciamento de relacionamento com clientes (CRM) ou transcrições de conversas anteriores. A pesquisa por similaridade semântica garante que não apenas as correspondências de palavras-chave, mas também as entradas conceitualmente relacionadas sejam recuperadas. O assistente cria uma pilha de contexto para referência durante a tomada de decisões e a geração de respostas.

7. Tomando decisões

Com base na intenção, nas entidades e no contexto recuperado, o assistente escolhe a próxima ação. Isso pode ser uma regra codificada (por exemplo, “if intent = reset_password → trigger workflow”) ou um mecanismo dinâmico de políticas impulsionado por aprendizado por reforço ou árvores de decisão. Sistemas avançados podem incorporar algoritmos de planejamento de IA para sequenciar várias ações. Se o escalonamento for necessário (por exemplo, a intenção for sensível ou complexa), o assistente encaminha a consulta para um humano com o contexto pré-preenchido.

8. Geração de respostas

O assistente agora cria uma resposta usando Geração aumentada por recuperação (RAG). Isso combina dados recuperados (por exemplo, um artigo de ajuda ou perfil de usuário) com um modelo de linguagem como o GPT para gerar respostas personalizadas em linguagem natural. Para fins transacionais, ele pode chamar APIs para buscar dados ao vivo (por exemplo, status do pedido) ou iniciar processos de back-end. As respostas são formatadas de acordo com o tom, a duração e a clareza, geralmente usando algumas instruções para se manterem alinhadas com a voz da empresa.

9. Corrimãos

Antes do envio, o sistema realiza várias verificações de segurança. Isso inclui filtros de política (por exemplo, evitar o envio de credenciais), análise de tom (garanta que o assistente não pareça rude ou desdenhoso) e pontos de verificação detalhados para categorias sinalizadas (por exemplo, clientes legais, de conformidade e VIP). Classificadores de toxicidade, detectores de PII e limitadores de taxa ajudam a garantir um comportamento responsável da IA. O registro ocorre em paralelo para fins de conformidade e auditoria.

10. Entrega e registro

Depois de aprovada, a assistente envia a resposta pelo mesmo canal de onde veio: e-mail, chat ou voz. Simultaneamente, ele registra os metadados da sessão, as pontuações de satisfação do usuário (por meio de avisos com o polegar para cima ou para o CSAT) e as principais métricas, como tempo até a primeira resposta (TTFR) ou tempo de resolução. Esses dados retornam ao pipeline de treinamento, onde o ajuste fino supervisionado ou RLHF (Reinforcement Learning from Human Feedback) melhora o desempenho futuro.

Com o tempo, esse ciclo melhora. Novos artigos são indexados, novos padrões são aprendidos e o feedback atualiza o modelo. O resultado? Um assistente mais inteligente que acompanha seus produtos, clientes e fluxos de trabalho.

Curioso sobre o impacto mais amplo? Saiba mais sobre como os assistentes de IA ajudam as empresas melhore a eficiência, reduza os custos e escale de forma mais inteligente.

Exemplos do mundo real: assistentes de IA no Gmail

Com plataformas como Gmelius, os assistentes de IA são incorporados diretamente no Gmail. Você não precisa de um novo aplicativo, apenas de um e-mail mais inteligente.

Os assistentes de IA da Gmelius vão além da automação em nível superficial. Eles podem se conectar com segurança à sua documentação interna, central de ajuda ou base de conhecimento para fornecer respostas baseadas nos fluxos de trabalho e no idioma reais da sua empresa.

Uma vez conectado, o assistente cria um índice vetorial seguro e privado do seu conteúdo, totalmente criptografado e nunca compartilhado ou usado para treinar modelos externos. Desenvolvido pela IA Gemini do Google e profundamente incorporado ao Gmail, o assistente atualiza continuamente seu entendimento toda semana, garantindo que ele reflita seus processos, políticas e conhecimento da equipe mais recentes com precisão e privacidade.

Aqui estão dois exemplos práticos:

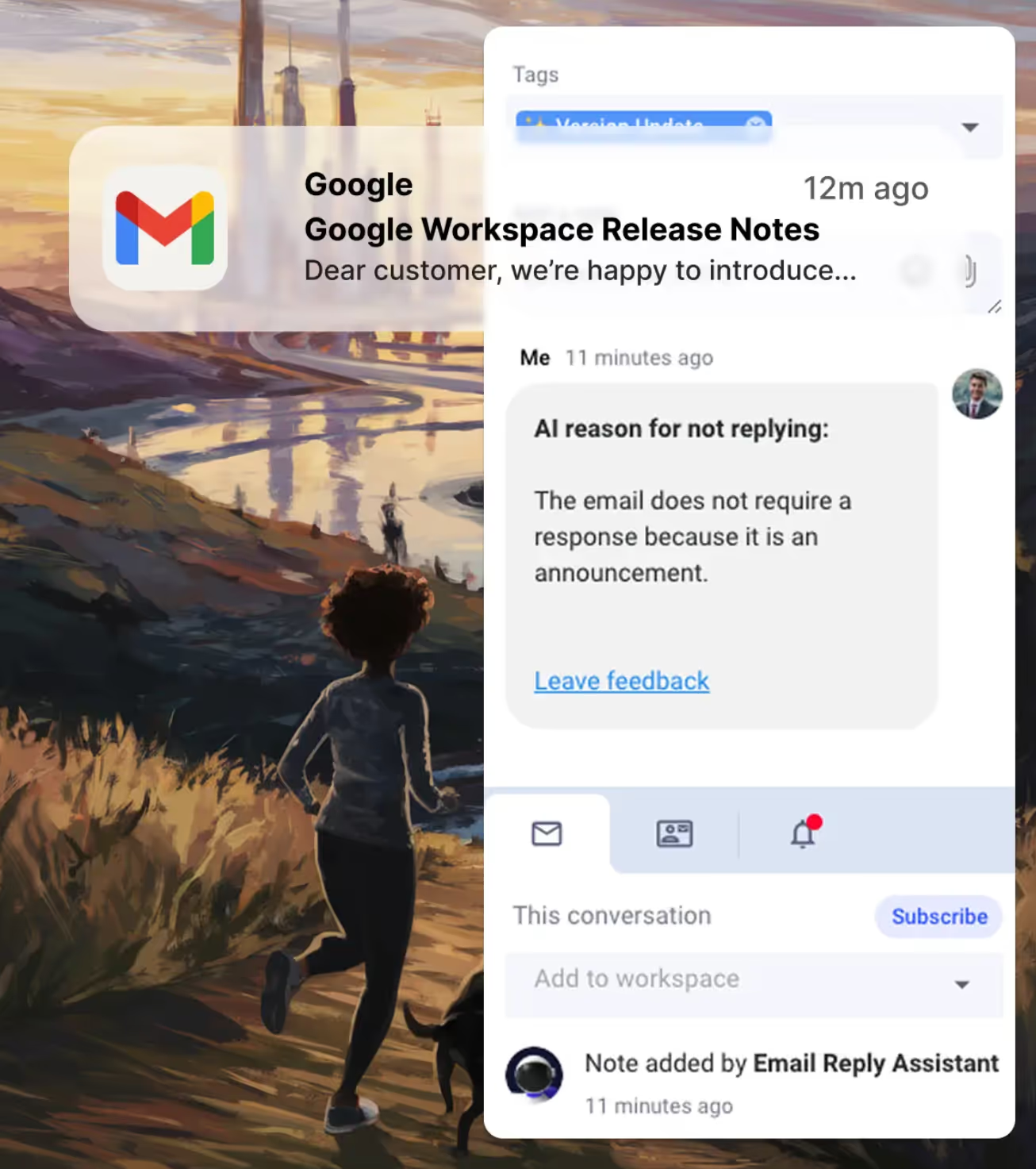

Assistente de resposta de e-mail Gmelius

Esse assistente elabora respostas inteligentes aos e-mails recebidos com base no tópico da conversa, nos modelos salvos e na base de conhecimento da empresa. Ele entende o tom, a intenção e a urgência, portanto, os agentes humanos podem simplesmente revisar e enviar.

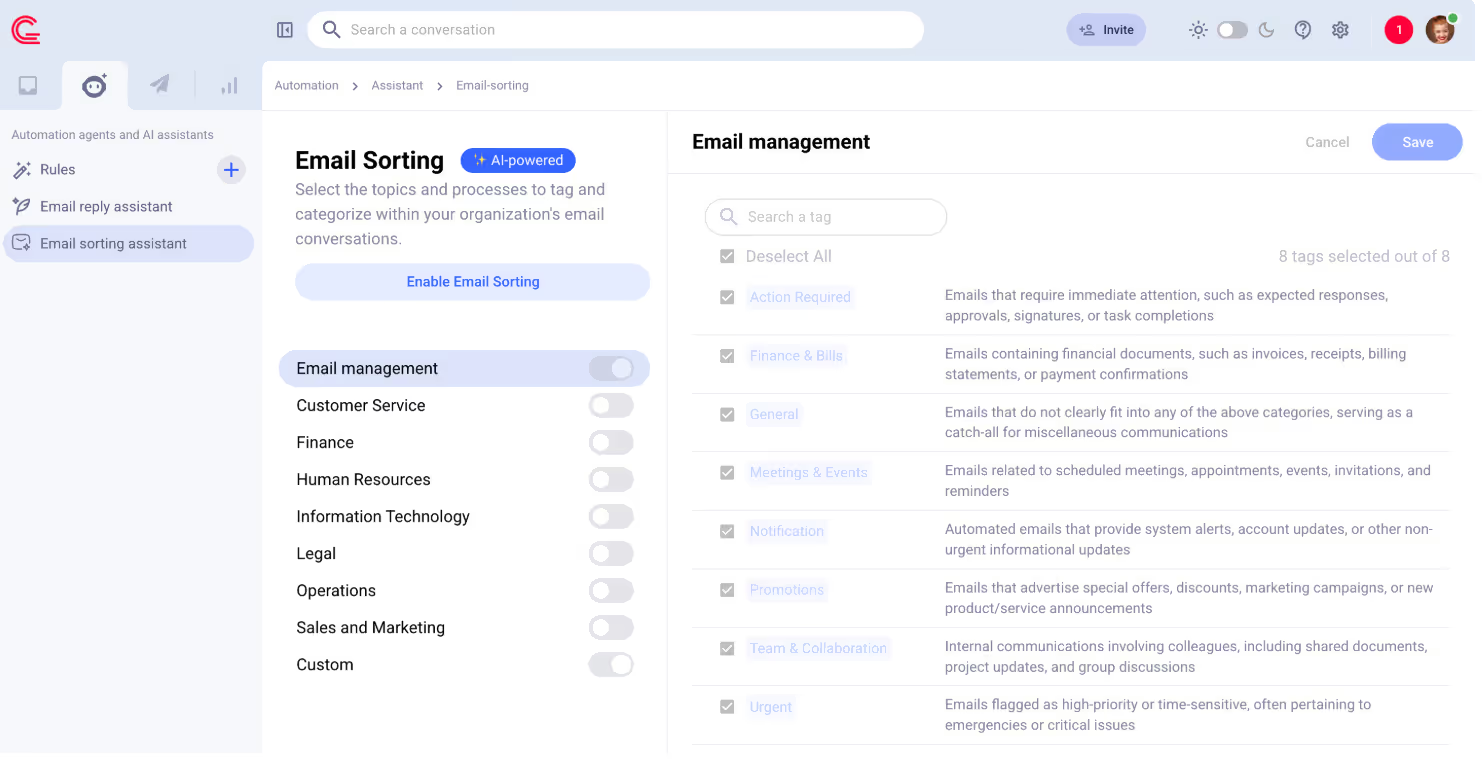

Assistente de classificação de e-mail Gmelius

Classifica automaticamente os e-mails (cobrança, suporte, feedback etc.) e os encaminha para a pessoa ou tag certa. As equipes eliminam a triagem manual e reduzem o tempo de resposta em todos os setores.

Como fazer com que os assistentes de IA trabalhem para você

Se você está pensando em adicionar um assistente de IA ao seu fluxo de trabalho de suporte ou operações, lembre-se dessas melhores práticas:

1. Comece com a repetição

Identifique as 3 a 5 tarefas que você mais repete: “Onde está meu pedido?” , “Como faço para redefinir minha senha?” , “Posso obter uma cópia da minha fatura?” Essas são vitórias fáceis para a automação.

2. Use seu próprio conhecimento

Faça upload de documentos internos, manuais de produtos e conteúdo de perguntas frequentes. Isso garante que seu assistente dê respostas em seu idioma, usando informações precisas.

3. Mantenha os humanos informados

Sempre permita a aprovação do agente em respostas complexas ou confidenciais, especialmente durante a primeira fase. A IA deve ajudar, não substituir, sua equipe.

4. Acompanhe o desempenho

Veja métricas como:

- Tempo de primeira resposta (FRT)

- Tempo de resolução (TTR)

- Taxa de deflexão (quantas consultas foram tratadas sem o envolvimento do agente)

5. Atualize com frequência

Defina um cronograma de atualizações recorrentes para que seu assistente receba qualquer novo conteúdo da Central de Ajuda, alterações no produto ou mudanças nas políticas.

6. Melhore a solicitação ao longo do tempo

À medida que o assistente lida com mais consultas, veja quais delas ele não responde bem. Refine seus materiais de treinamento e instruções para fechar essas lacunas.

Conclusão

Os assistentes de IA já fazem parte do fluxo de trabalho diário em milhares de equipes de suporte, empresas de SaaS e operações de comércio eletrônico. Quando conectados à sua base de conhecimento real e administrados com as barreiras corretas, eles reduzem a carga de trabalho, melhoram a experiência do cliente e ajudam as equipes a se tornarem mais inteligentes.

O que costumava exigir horas de esforço humano (rotear mensagens, extrair dados, responder com consistência) agora é tratado em segundos por assistentes inteligentes que aprendem, se adaptam e se adaptam à sua empresa.

Seja você uma startup em crescimento ou uma equipe estabelecida enterrada sob o controle de e-mails, a mensagem é clara: se você ainda está fazendo tudo manualmente, você já está atrasado.

Com ferramentas como Assistentes de IA da Gmelius, você não precisa revisar sua pilha nem criar sua própria solução. Basta conectá-lo ao Gmail e deixá-lo funcionar.

👉 Experimente o Gmelius gratuitamente

.avif)

.png)

.avif)

.avif)